最近、ニュースで「生成AI悪用」という言葉を耳にする機会が増えていませんか? 実はこれ、中高生が生成AIを使って通信回線を不正契約し、逮捕された事件に関連しています。このショッキングな事件をきっかけに、「生成AI悪用」というワードがTwitterで1万件近くもツイートされるなど、AI犯罪に対する懸念が高まっています。

さらに、ChatGPTやDeepFake(ディープフェイク)などの技術が急速に普及する中、SNSなどを通じて拡散されるリスクも注目されています。AI技術の進化は目覚ましいものですが、その裏では悪用されるケースが急増しているのです。

この記事では、生成AIの悪用事例と、私たちが知っておくべき対策について徹底解説します。さらに、AI企業や政府規制の裏話や最新の詐欺被害額などの数字を通して、今の状況を深掘りしていきます。

この記事の目次(クリックでジャンプ)

1. 生成AIとは?

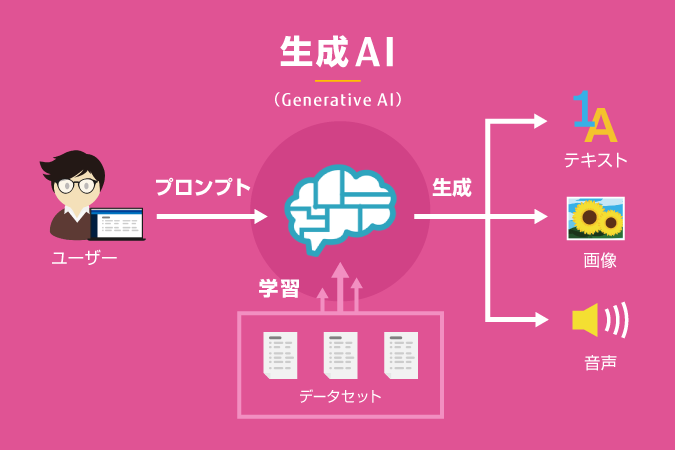

まずは生成AIとは何か、簡単に説明します。

生成AIとは、大量のデータから学習し、新しいコンテンツを生み出すAIのことを指します。文章、画像、音声、動画、プログラムコードなど、様々なものを生成できます。

例えば、ChatGPTのような対話型AIは、人間と自然な会話をすることができますし、Stable DiffusionやMidjourneyのような画像生成AIは、テキストから高画質の画像を生成することが可能です。

2. 生成AIを使った詐欺事例とSNS拡散リスク

生成AIは便利なツールである一方、使い方を誤ると様々な犯罪に悪用される可能性があります。特にSNSで拡散されるリスクが高いため、真偽不明の情報が瞬く間に広まることにも注意が必要です。以下に主要な悪用例をまとめます。

- 偽造書類の作成:偽の身分証明書や資格証明書などを作成

- 詐欺メールの作成:巧妙なフィッシングメールを生成し、個人情報を詐取

- 個人情報の不正取得:なりすましや情報収集に悪用

- 著作権侵害:既存の著作物を無断で複製・改変

- フェイクニュースの拡散:信憑性の低い情報を生成し、社会不安を煽る

- なりすまし:実在の人物になりすまし、詐欺や誹謗中傷を行う

- サイバー攻撃:マルウェアやウイルスを作成、拡散

- ディープフェイク:実際には存在しない映像や音声を生成し、なりすましや偽情報拡散に利用

- 学業における不正行為:レポートや論文をAIに作成させ、提出

- 差別的なコンテンツの生成:倫理的に問題のある、差別的なコンテンツを作成

実際に、中高生が生成AIを使って偽の身分証明書を作成し、通信回線を不正に契約する事件が起きました。従来の偽造書類と比べてAIが作成したものは精巧で、見破ることが難しいケースもあります。

また、ChatGPTの登場により、自然な文章生成が可能になったため、フィッシングメールの質も格段に向上。これまで不自然な日本語や文法ミスから見破られていた詐欺メールが、一見すると正しい日本語で作成されるようになりました。

さらに、ディープフェイクを使って政治家や有名人の偽映像を作成し、SNSで拡散させる手口も急増中です。世論操作や誹謗中傷、金銭目的の詐欺に利用されるなど、悪意のある利用が後を絶ちません。

3. 急増する詐欺被害額と背後にあるAI企業・政府規制の裏話

生成AIが悪用されると、次のような危険性が考えられます。

- 個人情報の漏洩: 偽サイトやフィッシングに騙され、重要情報を盗み取られる

- 金銭的な被害: 架空請求や投資詐欺などによる大損失

- 名誉毀損: ディープフェイクでの虚偽映像拡散による reputational damage

- 社会不安の増大: フェイクニュースで混乱を誘発

- 民主主義の脅威: 選挙への影響や政治的混乱

さらに、総務省の調査によると、2025年上半期だけでAI関連の詐欺被害総額が約30億円に達したとの報告があります。これは前年同期比で約2倍の規模です。

背景には、AI企業が急激に技術開発を進める一方で、法整備や倫理ガイドラインが追いついていないという問題があります。政府規制の裏話として、「自由なイノベーションを阻害したくない」という意見がある一方、社会的混乱を避けるためには厳格なルールが必要という議論も根強く、規制強化をめぐる攻防が続いているのです。

4. 生成AI悪用を防ぐための対策

生成AIの悪用を防ぐためには、私たち一人ひとりが以下の点を押さえることが重要です。

- 出所の怪しいAIツールは利用しない: 開発元や評判をチェック

- 生成されたコンテンツを安易に拡散しない: 倫理面・著作権の確認を徹底

- AI技術の倫理的側面を学ぶ: 責任ある利用方法やリスクを理解する

- 最新のAI動向にアンテナを張る: 新手口が次々登場するため要注意

- 個人情報や機密情報の入力を避ける: 悪用されるリスクを軽減する

- 生成物の事実確認を徹底する: AIの出力が正しいとは限らない

- AIで作成した旨を明示する: 公開時にはコンテンツの作成方法を透明化

5. 社会全体で取り組むべきこと

個人の対策に加え、社会全体での包括的なアプローチも求められます。

- AI倫理に関する教育: 学校・社会人教育で、責任あるAI利用を学ぶ機会を提供

- 政府による適切な規制: ルール作りや取り締まりの強化。イノベーションとのバランスが課題

- 企業の責任: 悪用防止の技術開発やユーザーへの注意喚起を徹底

- 国際的な協力: AI犯罪は国境を越える問題のため、グローバルな連携が必須

6. 生成AIと倫理的に共存する未来に向けて

生成AIは私たちの生活を大きく変え得る可能性を秘めていますが、一方で悪用されるリスクも無視できません。AI技術の急速な進歩は、新たな便利さと同時に、新たな課題や社会問題をもたらしているのです。

だからこそ、私たち自身がAIに関する知識や倫理観を高め、トラブルを未然に防ぐ意識を持つことが求められます。さらに、AI企業や政府が協力して適切な規制やガイドラインを整備し、被害を最小限に抑える努力が不可欠です。

この記事をきっかけに、生成AIの未来と、私たちがどのように付き合っていくべきか考えてみませんか?

あなたの声を聞かせてください!

感想・リクエスト・タレコミなど大歓迎!下の送信ボタンから、あなたの意見をぜひお寄せください。

🎁 今ならもれなく3大プレゼント! 🎁

- 💡 「最新詐欺手口&対策リスト(2025年版)」👉 急増する詐欺の手口と回避策を、わかりやすく解説!

- 💰 「知らなきゃ損!政府の補助金&助成金リスト」👉 住宅・子育て・医療・教育…今すぐ使えるお金をチェック!

- 🏦 「銀行・クレジットカードの隠れ手数料一覧」👉 知らずに払ってる手数料、サクッと削減する方法を伝授!

👇 あなたの一言が、新たな情報発信のヒントに!

今すぐ送信して、プレゼントをGET🎁✨